Politische Arbeit

Einführung

Verbesserung der Governance von transformativen Technologien

Das Politikteam des FLI arbeitet an der Verbesserung der nationalen und internationalen Governance im Bereich der KI. Zu diesem Zweck hat das FLI zahlreiche Bemühungen angeführt.

Im Jahr 2017 haben wir die einflussreichen Asilomar AI Principles entwickelt, eine Reihe von Governance-Grundsätzen, die von Tausenden führender Köpfe in der KI-Forschung und -Industrie unterzeichnet wurden. Kürzlich löste unser offener Brief 2023 eine weltweite Debatte über den rechtmäßigen Platz der KI in unserer Gesellschaft aus. FLI hat vor dem US-Kongress, dem Europäischen Parlament und anderen wichtigen Gerichtsbarkeiten Stellung genommen.

Im zivilen Bereich beraten wir politische Entscheidungsträger darüber, wie fortschrittliche KI-Systeme am besten reguliert werden können. Im militärischen Bereich setzen wir uns bei den Vereinten Nationen für ein Abkommen über autonome Waffen ein und informieren die politischen Entscheidungsträger über die Risiken der Integration von KI-Systemen in die Inbetriebnahme nuklearer Systeme.

Politische Projekte

Kampf gegen Deepfakes

AI-Sicherheitsgipfel

Entwicklung möglicher KI-Regeln für die USA

Auseinandersetzung mit der AI Executive Order

KI-Konvergenz: Risiken am Schnittpunkt von KI zu nuklearen, biologischen und Cyber-Bedrohungen

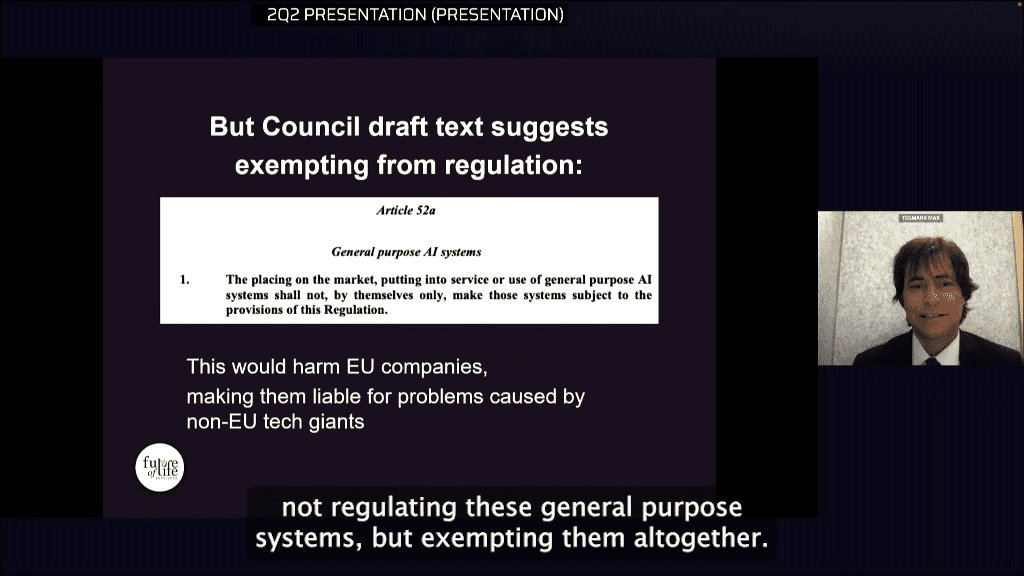

Stärkung der Europäischen Verordnung über Künstliche Intelligenz

Aufklärung über tödliche autonome Waffen

Globale KI-Governance bei den UN

Neueste Positionspapiere

RfC zu BIS-Regel zur "Festlegung von Meldepflichten für fortgeschrittene KI-Modelle und Rechencluster".

Die Vision in die Tat umsetzen: Die Umsetzung der KI-Roadmap des US-Senats

Empfohlene Änderungen an den Gesetzgebungsvorschlägen zu Deepfakes

FLI Antwort an OMB: Informationsanfrage zur verantwortungsvollen Beschaffung von künstlicher Intelligenz in der Regierung

Mehr laden

Geografischer Fokus

Wo Sie uns finden können

Vereinigte Staaten

Europäische Union

Vereinte Nationen

Errungenschaften

Einige der von uns erzielten Erfolge

Entwicklung der AI Asilomar Principles

KI-Empfehlung im Plan der UN für digitale Zusammenarbeit

Stellungnahme von Max Tegmark vor dem EU-Parlament

Ausgewählte Beiträge

Pariser AI-Sicherheitsfrühstück #2: Dr. Charlotte Stix

US-Repräsentantenhaus fordert gesetzliche Haftung für Deepfakes

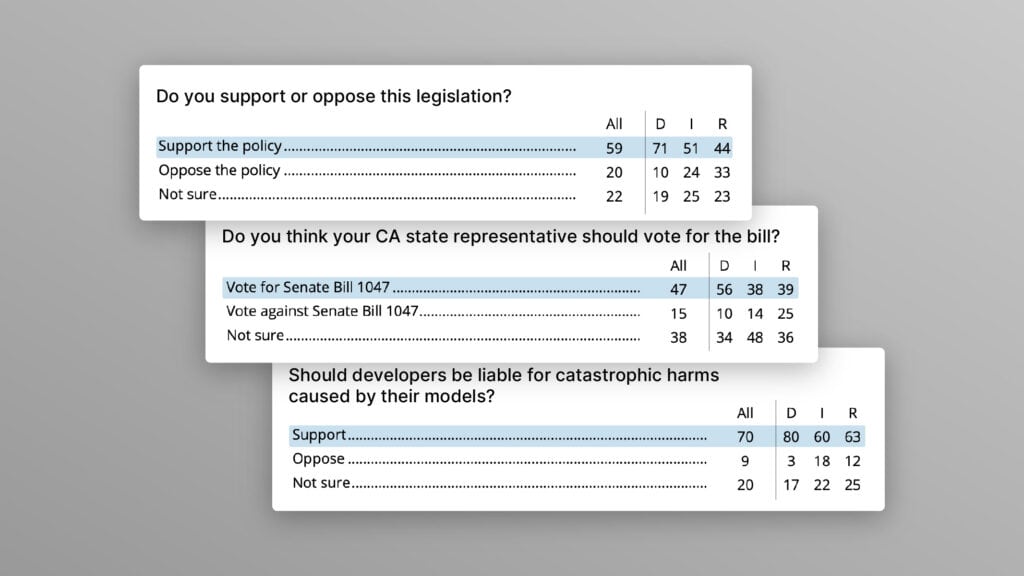

Stellungnahme zum Veto gegen das kalifornische Gesetz SB 1047

Panda vs. Adler

US-Bundesbehörden: Kartierung von AI-Aktivitäten

Pariser AI Safety Breakfast #1: Stuart Russell

Die Artist Rights Alliance und Annie Lennox sprechen sich für die Kampagne gegen Deepfakes aus