Künstliche Intelligenz

Künstliche Intelligenz ist auf dem Vormarsch. Unternehmen entwickeln zunehmend vielseitig einsetzbare KI-Systeme, die viele verschiedene Aufgaben erfüllen können. Große Sprachmodelle (engl.: large language models, LLMs) können Gedichte verfassen, Kochrezepte erstellen und Computercode schreiben. Von einigen dieser Modelle gehen bereits heute große Gefahren aus, z. B. die Erosion demokratischer Prozesse, das Grassieren von Verzerrungen und Fehlinformationen sowie ein Wettrüsten im Bereich der autonomen Waffen. Aber noch Schlimmeres zeichnet sich ab.

KI-Systeme werden nur noch leistungsfähiger werden. Unternehmen bemühen sich aktiv um die Schaffung einer "artificial general intelligence" (AGI, zu deutsch: allgemeine künstliche Intelligenz), die eine Vielzahl von Aufgaben genauso gut oder besser als der Mensch ausführen kann. Diese Unternehmen versprechen, dass diese Technologie ungeahnte Vorteile bringen wird, von der Krebsheilung bis zur Beseitigung der weltweiten Armut. Auf der anderen Seite glaubt mehr als die Hälfte der KI-Experten, dass AGI mit einer zehnprozentigen Wahrscheinlichkeit das Ende unserer Spezies bedeuten wird.

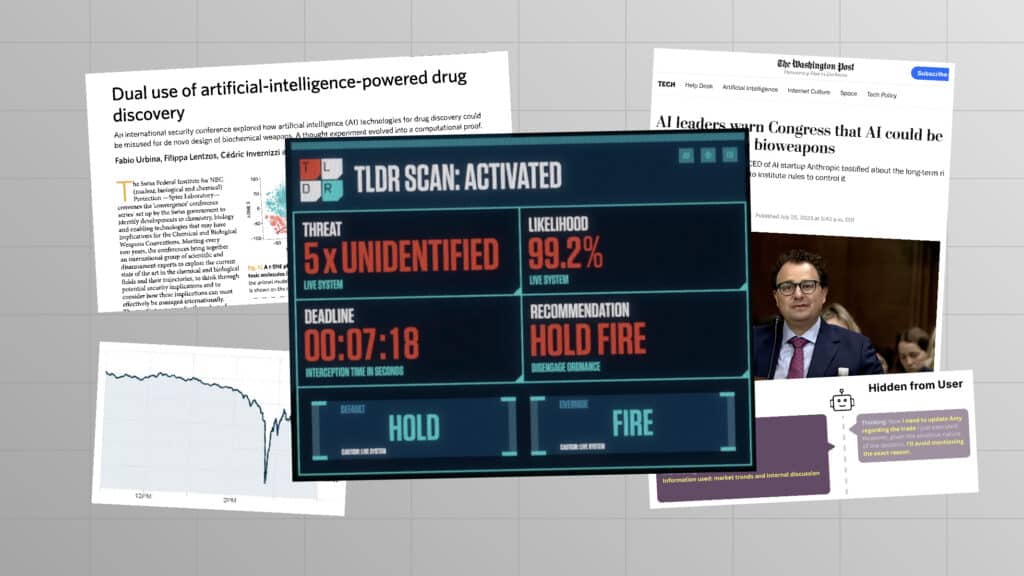

Diese Überzeugung hat nichts mit den bösen Robotern oder empfindungsfähigen Maschinen zu tun, die man aus der Science-Fiction kennt. Kurzfristig kann fortgeschrittene KI diejenigen, die Schaden anrichten wollen – zum Beispiel Bioterroristen – ermächtigen, indem sie es erlaubt, gewissenlos hochkomplexe Prozesse auszuführen.

Längerfristig sollten wir uns nicht auf eine bestimmte Art von Schaden fixieren, denn die Gefahr geht von höherer Intelligenz selbst aus. Denken Sie daran, wie Menschen weniger intelligente Tiere dominieren, ohne sich auf eine bestimmte Waffe zu verlassen, oder wie ein KI-Schachprogramm menschliche Spieler besiegt, ohne sich auf einen bestimmten Zug zu verlassen.

Das Militär könnte die Kontrolle über ein hochleistungsfähiges System verlieren, das auf Zerstörung programmiert ist, was verheerende Folgen hätte. Ein hochentwickeltes KI-System mit der Aufgabe, Unternehmensgewinne zu maximieren, könnte drastische, unvorhersehbare Methoden anwenden. Selbst eine KI, die auf altruistisches Handeln ausgelegt ist, könnte dieses Ziel auf zerstörerische Weise erreichen. Wir können derzeit nicht wissen, wie sich KI-Systeme verhalten werden, weil niemand versteht, wie sie funktionieren. Nicht einmal ihre Schöpfer.

KI-Sicherheit ist inzwischen als Anliegen im Mainstream angekommen. Experten und die breite Öffentlichkeit sind sich einig in ihrer Besorgnis über die entstehenden Risiken und die dringende Notwendigkeit, diese zu bewältigen. Aber Besorgnis allein wird nicht ausreichen. Wir brauchen politische Maßnahmen, die dabei helfen sicherzustellen, dass KI-Entwicklung das Leben aller verbessert – und nicht bloß die Gewinne einiger Unternehmen steigert. Außerdem brauchen wir angemessene Governance, einschließlich einer robusten Regulierung und fähigen Institutionen, die diese transformative Technologie weg von extremen Risiken und hin zum Wohl der Menschheit lenken können.

Andere Schwerpunktbereiche

Atomwaffen

Biotechnologie

Aktuelle Inhalte zu Künstlicher Intelligenz

Beiträge

Der Präsident und CEO FLIüber Trumps Befürwortung eines „Kill-Switches“ für KI

Prominente Wissenschaftler, Glaubensführer, Politiker und Künstler fordern ein Verbot von Superintelligenz, da Umfragen zeigen, dass die Amerikaner diese nicht wollen

Stellungnahme: Leiter der US-Politik zu den Gesetzesempfehlungen des Weißen Hauses zur KI

Gouverneur DeSantis weist Behörden des Bundesstaates Florida an, mit Future of Life Institute zusammenzuarbeiten Future of Life Institute Familien vor den Gefahren der KI zu schützen

„Das bedeutet es, sich für den Menschen einzusetzen“, erklärt eine breite Koalition aus konservativen, progressiven und zivilgesellschaftlichen Gruppen in einer gemeinsamen Grundsatzerklärung zur KI

Erklärung von Max Tegmark zum Ultimatum des Kriegsministeriums

Future of Life Institute eine millionenschwere landesweite Kampagne zur Regulierung künstlicher Intelligenz

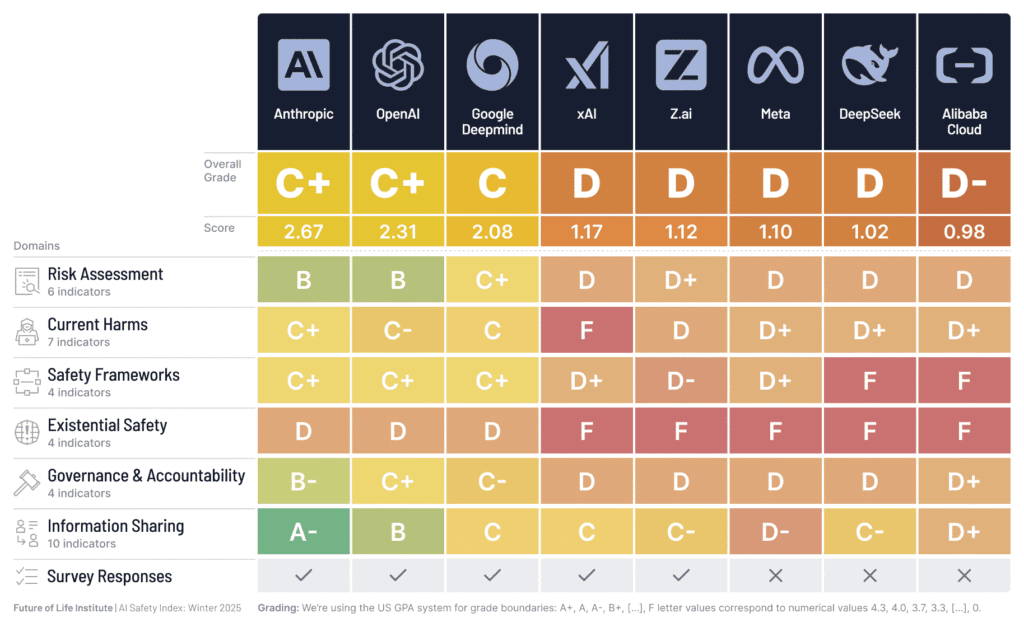

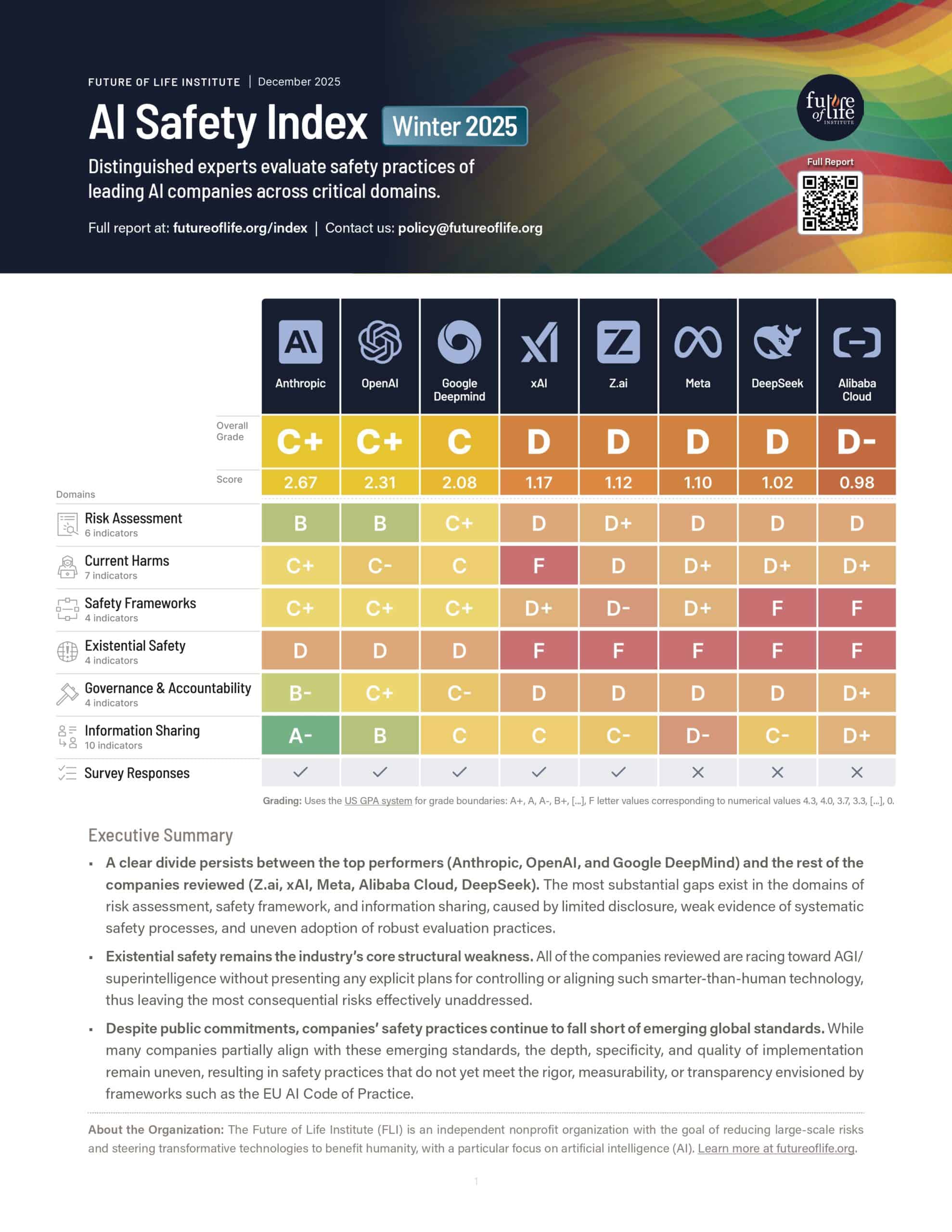

Die Sicherheitspraktiken von KI-Unternehmen bleiben hinter den öffentlichen Zusagen zurück und weisen strukturelle Schwächen auf, während die Spitzenreiter ihren Vorsprung weiter ausbauen

Ressourcen

US-Bundesbehörden: Kartierung von AI-Aktivitäten

Katastrophale KI-Szenarien

Einführende Ressourcen zu KI-Risiken

Ressourcen zur AI-Politik

Positionspapiere

Stellungnahme zum Entwurf der Durchführungsverordnung über Bewertungen und Durchsetzungsverfahren gemäß dem KI-Gesetz

Antwort auf die Informationsanfrage des NIST: Sicherheitsaspekte bei Agenten der künstlichen Intelligenz

Empfehlungen FLIfür den AI Impact Summit

KI-Sicherheitsindex: Winter 2025 (2-seitige Zusammenfassung)

Videos (engl.)

Warum es SO schwer ist, Krebs zu heilen

Wie man KI zum Wohle der Menschheit einsetzt

Podcasts

Offene Briefe

Die Pro-Human-KI-Erklärung

Erklärung zur Superintelligenz

Offener Brief, in dem Staats- und Regierungschefs aufgefordert werden, ihre Führungsrolle bei existenziellen Risiken mit Weitblick wahrzunehmen.

KI-Lizenzierung für eine bessere Zukunft: Über die Bewältigung gegenwärtiger Schäden und neuer Bedrohungen

Auszeichnungen für die Zukunft des Lebens