Politik und Forschung

Unser Ziel ist es, den Umgang mit künstlicher Intelligenz und deren Überschneidung mit biologischen, nuklearen und Cyber-Risiken zu verbessern.

Einführung

Verbesserung der Governance im Bereich transformativer Technologien

Das Politikteam von FLI daran, die nationale und internationale Regulierung von KI zu verbessern.

Im Jahr 2017 haben wir die einflussreichen Asilomar-KI-Prinzipien geschaffen, eine Reihe von Governance-Prinzipien, die von Tausenden führenden Köpfen aus der KI-Forschung und -Industrie unterzeichnet wurden. Vor kurzem hat unser Offener Brief 2023 eine globale Debatte über den richtigen Platz der KI in unseren Gesellschaften ausgelöst. FLI nimmt FLI an zwischenstaatlichen Konferenzen teil und berät Regierungen auf der ganzen Welt in Fragen der KI-Governance.

Unsere Arbeit

Projektdatenbank

Religiöse Perspektiven auf eine positive KI-Zukunft

Der Großteil der Weltbevölkerung gehört einer Religion an. Dennoch sind die Perspektiven dieser Religionen in den strategischen Diskussionen über künstliche Intelligenz weitgehend abwesend. Diese Initiative zielt darauf ab, religiöse Gruppen dabei zu unterstützen, ihre glaubensspezifischen Bedenken und Hoffnungen für eine Welt mit KI zu äußern und mit ihnen zusammenzuarbeiten, um Schäden abzuwenden und Vorteile zu realisieren.

Förderung eines globalen KI-Abkommens

Wir brauchen internationale Koordination, damit die Vorteile der KI weltweit zum Tragen kommen und sich nicht nur auf wenige Orte konzentrieren. Die Risiken fortschrittlicher KI bleiben nicht innerhalb der Landesgrenzen, sondern verbreiten sich weltweit und betreffen alle Menschen. Wir sollten auf einen internationalen Regulierungsrahmen hinarbeiten, der eine Konzentration der Vorteile auf wenige Orte verhindert und die globalen Risiken fortschrittlicher KI mindert.

Empfehlungen für den AI-Aktionsplan der USA

Der Vorschlag des Future of Life Institute für den KI-Aktionsplan von Präsident Trump. Unsere Empfehlungen zielen darauf ab, die Präsidentschaft vor dem Kontrollverlust über KI zu schützen, die Entwicklung von KI-Systemen frei von ideologischen oder sozialen Agenden zu fördern, amerikanische Arbeitnehmer vor Arbeitsplatzverlust und Ersatz zu schützen und vieles mehr.

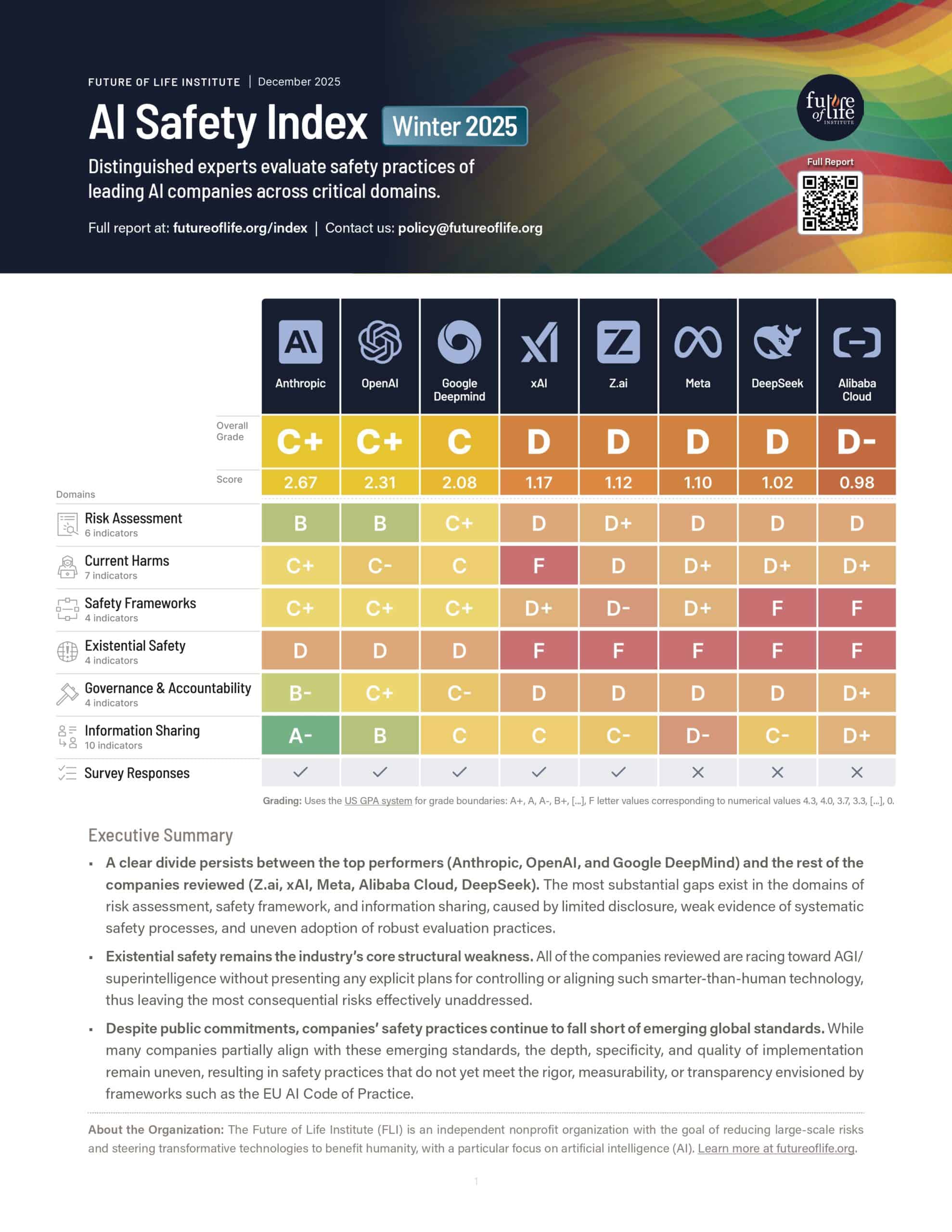

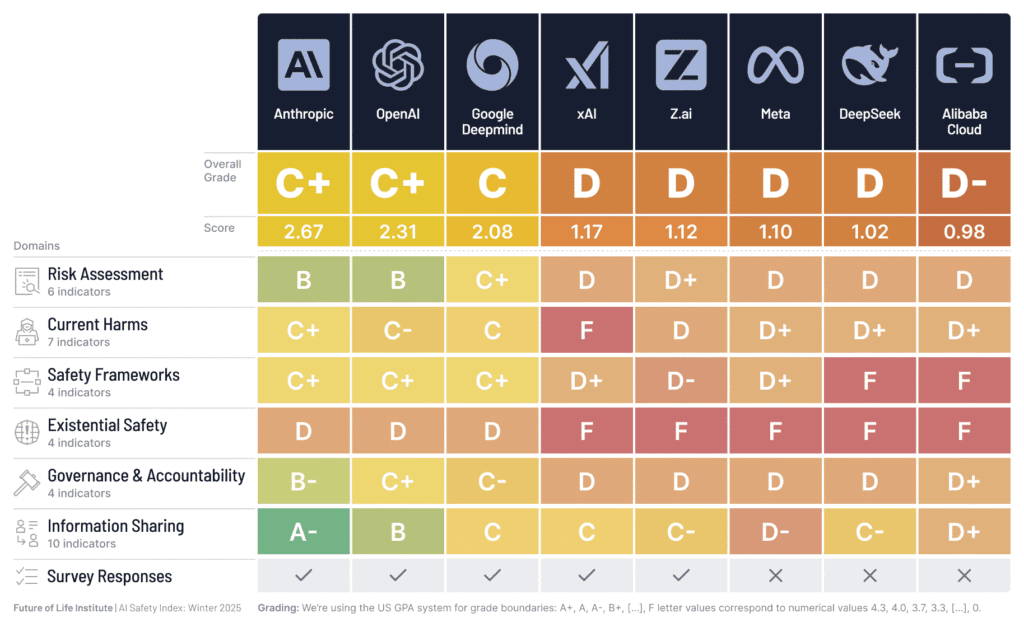

FLI : Ausgabe Winter 2025

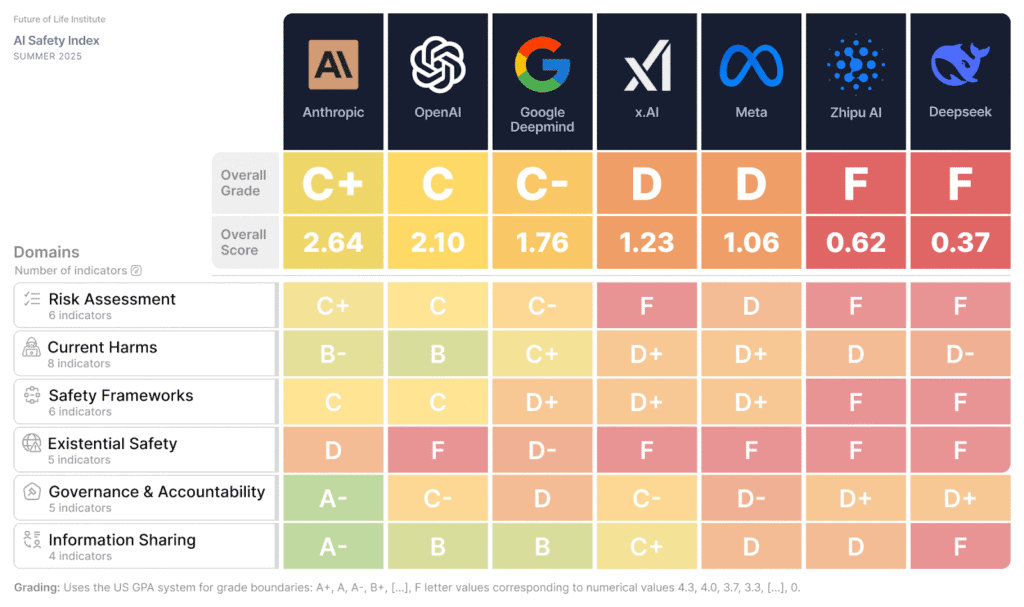

Acht KI- und Governance-Experten bewerten die Sicherheitspraktiken führender Allzweck-KI-Unternehmen.

KI-Konvergenz: Risiken am Schnittpunkt von KI zu nuklearen, biologischen und Cyber-Bedrohungen

Das Gefahrenpotenzial von KI-Systemen kann die Gefahrenpotenziale anderer Technologien verstärken – dies wird als KI-Konvergenz bezeichnet. Wir bieten politischen Entscheidungsträgern in den Vereinigten Staaten politische Expertise in drei wichtigen Konvergenzbereichen: Bio-, Nuklear- und Cybertechnologien.

KI-Sicherheitsgipfel

Die Regierungen erkunden die Zusammenarbeit bei der Navigation in einer Welt mit fortschrittlicher KI. FLI steht ihnen mit Rat und Tat zur Seite.

Umsetzung des europäischen AI-Gesetzes

Zu unseren wichtigsten Empfehlungen gehören die Ausweitung des Geltungsbereichs des Gesetzes zur Regulierung von allgemeinen KI-Systemen, sowie die Ausweitung der Definition verbotener Manipulation auf alle Arten von Manipulationstechniken sowie auf Manipulationen, die gesellschaftlichen Schaden verursachen.

Aufklärungsarbeit über autonome Waffensysteme

Militärische KI-Anwendungen breiten sich rasch aus. Wir entwickeln Bildungsmaterial darüber, wie bestimmte Klassen von KI-gesteuerten Waffen der nationalen Sicherheit schaden und die Zivilisation destabilisieren können, wie etwa Waffen, bei denen Tötungsentscheidungen vollständig an Algorithmen delegiert werden.

Unsere gesamte Arbeit

Unsere Inhalte

Aktuelle Politik- und Forschungspapiere

Produziert von uns

Stellungnahme zum Entwurf der Durchführungsverordnung über Bewertungen und Durchsetzungsverfahren gemäß dem KI-Gesetz

April 2026

Antwort auf die Informationsanfrage des NIST: Sicherheitsaspekte bei Agenten der künstlichen Intelligenz

März 2026

Empfehlungen FLIfür den AI Impact Summit

Februar 2026

KI-Sicherheitsindex: Winter 2025 (2-seitige Zusammenfassung)

Dezember 2025

Mehr laden

Alle Dokumente

Mit unseren Mitarbeitern und Stipendiaten

KI-Rahmenwerk zur Teilhabe an Vorteilen: Zugang und Sicherheit in Einklang bringen

Sumaya Nur Adan, Joanna Wiaterek, Varun Sen Bahl, Ima Bello, Luise Eder, José Jaime Villalobos, Anna Yelizarova u. a.

Dezember 2025

Untersuchung populärer Argumente gegen das existenzielle Risiko von KI: Eine philosophische Analyse

Torben Swoboda, Risto Uuk, Lode Lauwaert, Andrew Peter Rebera, Ann-Katrien Oimann, Bartlomiej Chomanski, Carina Prunkl

November 2025

Ein Entwurf für die multinationale Entwicklung fortschrittlicher KI

Adrien Abecassis, Jonathan Barry, Ima Bello, Yoshua Bengio, Antonin Bergeaud, Yann Bonnet, Philipp Hacker, Ben Harack, Sophia Hatz u. a.

November 2025

Ausblick: Synergien zwischen dem EU-KI-Amt und der britischen AISI

Lara Thurnherr, Risto Uuk, Tekla Emborg, Marta Ziosi, Isabella Wilkinson, Morgan Simpson, Renan Araujo und Charles Martinet

März 2025

Mehr laden

Ressourcen

Wir stellen hochwertige politische Ressourcen zur Unterstützung von Entscheidungsträgern bereit

US-Bundesbehörden: Kartierung von AI-Aktivitäten

Dieser Leitfaden gibt einen Überblick über die KI-Aktivitäten der US-Exekutive und konzentriert sich dabei auf Regulierungsbehörden, Budgets und Programme.

9 September, 2024

EU AI Act Explorer und Compliance Checker

Lesen Sie den vollständigen Text des KI-Gesetzes online und erfahren Sie in 10 Minuten, wie sich das KI-Gesetz auf Sie auswirken wird, indem Sie eine Reihe von einfachen Fragen beantworten.

15 Januar, 2024

Website über autonome Waffensysteme

Das Zeitalter, in dem Algorithmen über Leben und Tod entscheiden, ist angebrochen. Wir müssen jetzt handeln, um diese Waffen zu verbieten und zu regulieren.

20 November, 2017

Geografischer Fokus

Wo Sie uns finden können

Als Organisation streuen wir unsere Aktivitäten. Der Großteil unserer politischen Arbeit findet in den USA (D.C. und Kalifornien), in der EU (Brüssel) und bei den Vereinten Nationen (New York und Genf) statt.

Vereinigte Staaten

In den USA beteiligt sich FLI an der Arbeitsgruppe des US AI Safety Institute und fördert die KI-Gesetzgebung auf Landes- und Bundesebene.

Europäische Union

In Europa liegt unser Schwerpunkt auf der konsequenten Umsetzung der EU-KI-Gesetzgebung und der Ermutigung europäischer Staaten, einen Vertrag über autonome Waffen zu unterstützen.

Vereinte Nationen

Bei den Vereinten Nationen setzt sich FLI für einen Vertrag über autonome Waffen und eine neue internationale Agentur zur Governance von KI ein.

Unsere Inhalte

Ausgewählte Beiträge

Hier finden Sie eine Auswahl von Beiträgen, die sich auf unsere politische Arbeit beziehen:

„Magnificent Humanity“ – Die erste Enzyklika des Papstes befasst sich mit künstlicher Intelligenz

Alles, was Sie über die bevorstehende Enzyklika zum Thema KI wissen müssen.

20 Mai, 2026

Arbeitsgruppe des Weißen Hauses zum Thema KI – Stellungnahme von Anthony Aguirre FLI

„Dieser Schritt des Weißen Hauses ist auch ein Eingeständnis, dass die großen Technologiekonzerne sich nicht selbst regulieren können und dass der Status quo inakzeptabel ist.“

5 Mai, 2026

Stellungnahme: Leiter der US-Politik zu den Gesetzesempfehlungen des Weißen Hauses zur KI

Das Weiße Haus hat am Freitag seine lang erwarteten Empfehlungen zur KI-Gesetzgebung veröffentlicht, in denen es den Kongress weiterhin dazu auffordert, […]

22 März, 2026

Die Sicherheitspraktiken von KI-Unternehmen bleiben hinter den öffentlichen Zusagen zurück und weisen strukturelle Schwächen auf, während die Spitzenreiter ihren Vorsprung weiter ausbauen

Ein Gewinn für die Transparenz war jedoch, dass sich fünf führende Unternehmen erstmals an der Umfrage der Scorecard beteiligten und der Öffentlichkeit damit wichtige neue Informationen zur Verfügung stellten.

2 Dezember, 2025

Michael Kleinman reagiert auf die bahnbrechende Gesetzgebung zur KI-Sicherheit

Das FLI feiert einen Meilenstein für die KI-Sicherheitsbewegung und unterstreicht ihre wachsende Dynamik

3 Oktober, 2025

Google DeepMind fällt bei der jüngsten Sicherheitsüberprüfung hinter OpenAI zurück; laut Experten bleiben alle KI-Unternehmen weiterhin hinter den Erwartungen zurück

Das Sommer-Update 2025 des „AI Safety Index“ Future of Life Institutezeigt, dass einige Unternehmen zwar schrittweise Fortschritte erzielen, in Schlüsselbereichen wie der Risikobewertung und der Kontrolle der Systeme, die sie entwickeln wollen, jedoch weiterhin gefährliche Lücken bestehen.

17 Juli, 2025

Kontext und Agenda für den KI-Aktionsgipfel 2025

Der AI Action Summit wird vom 10. bis 11. Februar 2025 in Paris stattfinden. Hier finden Sie die Tagesordnung und die wichtigsten Ergebnisse.

31 Januar, 2025

FLI Erklärung zum Memorandum des Weißen Hauses zur nationalen Sicherheit

Letzte Woche veröffentlichte das Weiße Haus ein National Security Memorandum über KI-Governance und Risikomanagement. Das NSM enthält Leitlinien [...]

28 Oktober, 2024

Unsere Inhalte

Kontaktieren Sie uns

Wir bringen Sie mit der richtigen Person in Kontakt.

Wir tun unser Bestes, um alle eingehenden Anfragen innerhalb von drei Werktagen zu beantworten. Unser Team ist über den ganzen Globus verteilt. Bitte nehmen Sie Rücksicht und denken Sie daran, dass die Person, die Sie kontaktieren, sich möglicherweise nicht in Ihrer Zeitzone befindet.

Bitte richten Sie Medienanfragen und Einladungen zu Vorträgen für Max Tegmark an press@futureoflife.org. Alle anderen Anfragen können an contact@futureoflife.orggesendet werden.