Politique et recherche

Nous visons à améliorer la gouvernance de l'intelligence artificielle et son intersection avec les risques biologiques, nucléaires et cybernétiques.

Introduction

Améliorer la gouvernance des technologies de transformation

L'équipe chargée des politiques publiques au FLI d'améliorer la gouvernance nationale et internationale de l'IA.

En 2017, nous avons créé les principes influents d'Asilomar sur l'IA, un ensemble de principes de gouvernance signés par des milliers d'esprits éminents dans le domaine de la recherche et de l'industrie de l'IA. Plus récemment, notre lettre ouverte de 2023 a suscité un débat mondial sur la place légitime de l'IA dans nos sociétés. FLI participe FLI à des conférences intergouvernementales et conseille les gouvernements du monde entier sur les questions de gouvernance de l'IA.

Notre travail

Base de données du projet

Les perspectives des religions traditionnelles sur des avenirs positifs avec l'IA

La majorité de la population mondiale pratique une religion traditionnelle. Pourtant, les perspectives religieuses sont généralement absentes des discussions stratégiques sur l'IA. Cette initiative vise à aider les groupes religieux à exprimer, selon leur foi, leurs préoccupations et leurs espoirs pour un monde avec l’IA, et à collaborer avec eux pour en éviter les dérives et en réaliser les promesses.

Promouvoir un accord mondial sur l'IA

Nous avons besoin d'une coordination internationale afin que les avantages de l'IA profitent à l'ensemble de la planète, et ne se concentrent pas uniquement dans quelques endroits. Les risques liés à l'IA avancée ne resteront pas confinés à l'intérieur des frontières, mais se propageront à l'échelle mondiale et toucheront tout le monde. Nous devons œuvrer à la mise en place d'un cadre de gouvernance international qui empêche la concentration des avantages dans quelques endroits et atténue les risques mondiaux liés à l'IA avancée.

Recommandations pour le plan d'action américain en matière d'IA

La proposition du Future of Life Institute pour le plan d'action du président Trump en matière d'IA. Nos recommandations visent à protéger la présidence contre la perte de contrôle de l'IA, à promouvoir le développement de systèmes d'IA exempts d'agendas idéologiques ou sociaux, à protéger les travailleurs américains contre la perte et le remplacement d'emplois, et plus encore.

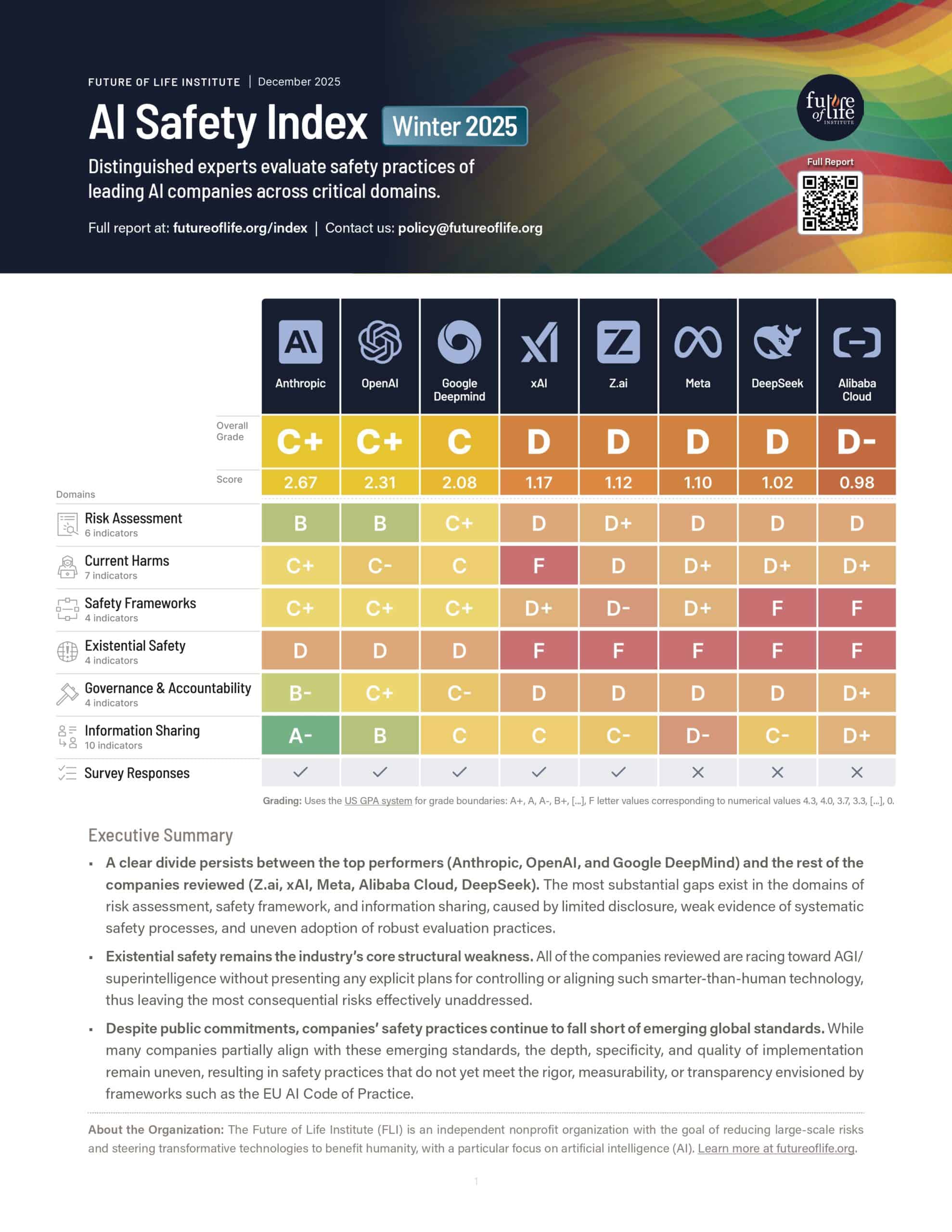

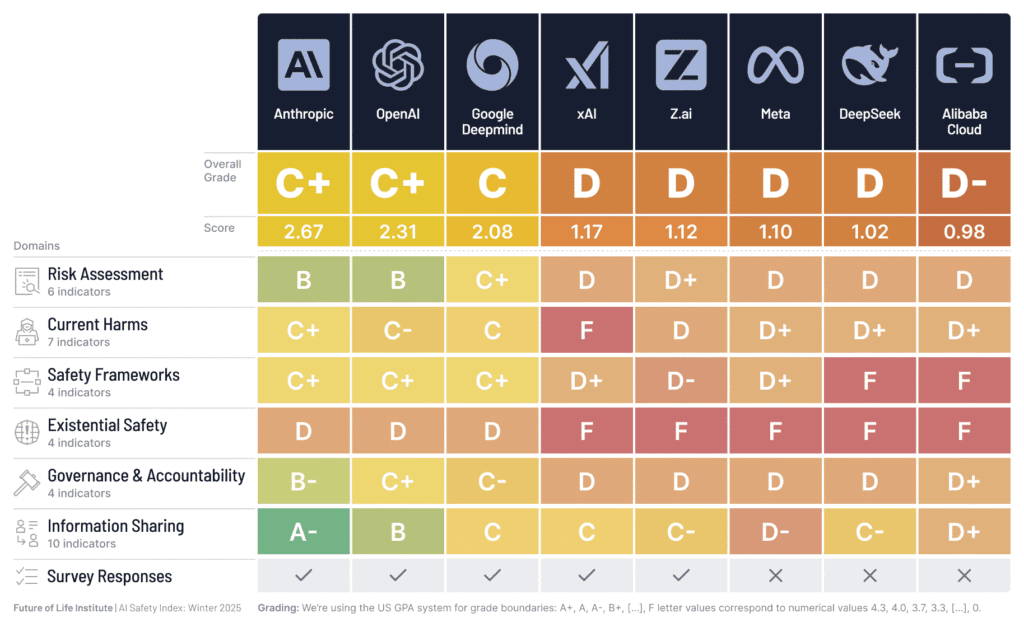

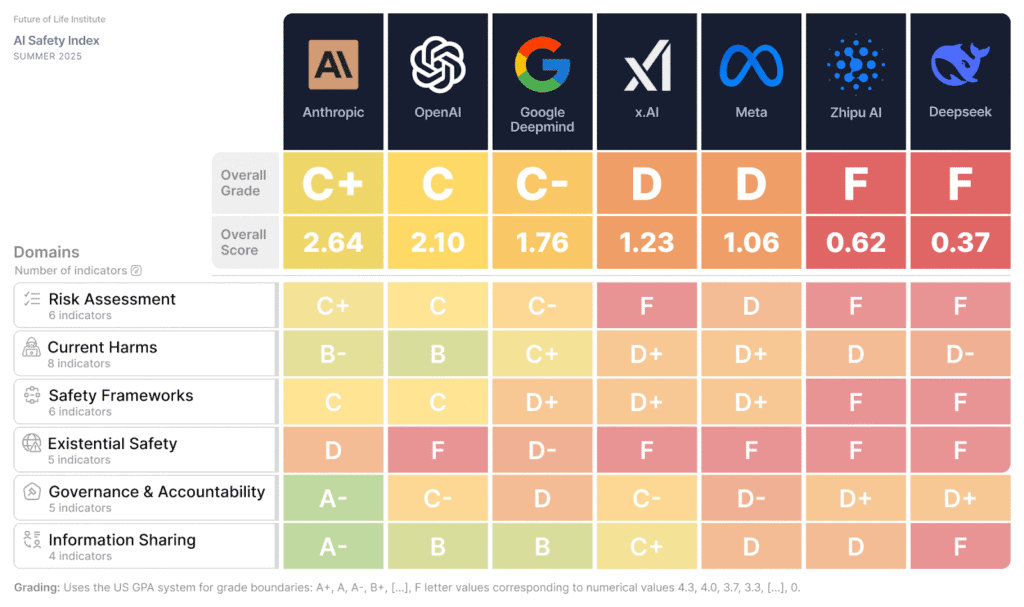

Indice FLI Safety : Édition hiver 2025

Huit experts en IA et en gouvernance évaluent les pratiques de sécurité des principales entreprises d'IA à usage général.

Convergence de l'IA : risques à la croisée de l'IA et des menaces nucléaires, biologiques et cybernétiques

Le caractère à double tranchant des systèmes d'IA peut amplifier celui d'autres technologies - c'est ce que l'on appelle la convergence de l'IA. Nous fournissons une expertise politique aux décideurs américains dans trois domaines essentiels de convergence : biologique, nucléaire et cybernétique.

Sommets sur la sécurité de l'IA

Les gouvernements envisagent de collaborer pour naviguer dans un monde doté d'une IA avancée. FLI leur fournit des conseils et un soutien.

Mise en œuvre de la loi européenne sur l'IA

Nos principales recommandations consistent à élargir le champ d'application de la loi pour réglementer les systèmes à usage général et elles visent à étendre la définition de la manipulation interdite à tout type de technique de manipulation, ainsi qu'à la manipulation qui cause un préjudice à la société.

Sensibilisation aux armes autonomes

Les applications militaires de l'IA se développent rapidement. Nous élaborons des documents pédagogiques sur la manière dont certaines catégories restreintes d'armes utilisant l'IA peuvent nuire à la sécurité nationale et déstabiliser la civilisation, notamment les armes dans lesquelles la décision de tuer est entièrement déléguée à des algorithmes.

Tous nos travaux

Nos contenus

Derniers documents de politique et de recherche

Produit par nous

Commentaires sur le projet de règlement d'application relatif aux évaluations et aux procédures d'exécution prévues par la loi sur l'IA

Avril 2026

Réponse à la demande d'informations du NIST : Considérations de sécurité relatives aux agents d'intelligence artificielle

mars 2026

Recommandations FLIpour le Sommet sur l'impact de l'IA

Février 2026

Indice de sécurité de l'IA : hiver 2025 (résumé de 2 pages)

Décembre 2025

Télécharger la suite

Tous les documents

Présentation de notre personnel et de nos boursiers

Cadre de partage des avantages de l'IA : trouver l'équilibre entre accès et sécurité

Sumaya Nur Adan, Joanna Wiaterek, Varun Sen Bahl, Ima Bello, Luise Eder, José Jaime Villalobos, Anna Yelizarova, et al.

Décembre 2025

Examen des arguments populaires contre le risque existentiel de l'IA : une analyse philosophique

Torben Swoboda, Risto Uuk, Lode Lauwaert, Andrew Peter Rebera, Ann-Katrien Oimann, Bartlomiej Chomanski, Carina Prunkl

Novembre 2025

Un plan directeur pour le développement multinational de l'IA avancée

Adrien Abecassis, Jonathan Barry, Ima Bello, Yoshua Bengio, Antonin Bergeaud, Yann Bonnet, Philipp Hacker, Ben Harack, Sophia Hatz, et al.

Novembre 2025

Perspectives d'avenir : synergies entre le Bureau européen de l'IA et l'AISI britannique

Lara Thurnherr, Risto Uuk, Tekla Emborg, Marta Ziosi, Isabella Wilkinson, Morgan Simpson, Renan Araujo et Charles Martinet

Mars 2025

Télécharger la suite

Ressources

Nous fournissons des ressources politiques de haute qualité pour soutenir les décideurs politiques.

Agences fédérales américaines : Cartographie des activités d'IA

Ce guide présente les activités liées à l'IA au sein du pouvoir exécutif américain, en mettant l'accent sur les autorités réglementaires, les budgets et les programmes.

9 Septembre, 2024

Explorateur et vérificateur de conformité à la loi sur l'IA de l'UE

Consultez le texte intégral de la loi sur l'IA en ligne et découvrez en 10 minutes comment la loi sur l'IA vous affectera en répondant à une série de questions simples.

15 janvier, 2024

Site web sur les armes autonomes

L'ère où les algorithmes décident de la vie et de la mort est en marche. Nous devons agir maintenant pour interdire et réglementer ces armes.

20 novembre, 2017

Cible géographique

Où nous trouver

Nous sommes une organisation hybride. La plupart de nos activités politiques ont lieu aux États-Unis (D.C. et en Californie), au sein de l'UE (Bruxelles) et à l'ONU (New York et Genève).

États-Unis

Aux États-Unis, le FLI participe au consortium de l'US AI Safety Institute et promeut la législation sur l'IA au niveau des États et au niveau fédéral.

Union européenne

En Europe, nous nous concentrons sur la mise en œuvre rigoureuse de la loi européenne sur l'IA et sur l'encouragement des États européens à favoriser l'adoption d'un traité sur les armes autonomes.

Nations Unies

À l'ONU, le FLI plaide en faveur d'un traité sur les armes autonomes et d'une nouvelle agence internationale pour gérer l'IA.

Nos contenus

Articles à la une

Voici une sélection d'articles relatifs à notre travail politique :

Déclaration : Responsable de la politique américaine concernant les recommandations législatives de la Maison Blanche en matière d'IA

La Maison Blanche a publié vendredi ses recommandations législatives tant attendues sur l'IA, et celles-ci continuent d'appeler le Congrès à […]

22 Mars, 2026

Les pratiques de sécurité des entreprises spécialisées dans l'IA ne sont pas à la hauteur de leurs engagements publics et révèlent des faiblesses structurelles, tandis que les plus performantes creusent l'écart

Mais, dans un élan en faveur de la transparence, cinq grandes entreprises ont participé pour la première fois à l'enquête menée dans le cadre de ce classement, fournissant ainsi au public de nouvelles informations essentielles.

2 Décembre, 2025

Michael Kleinman réagit à l'avancée de la législation sur la sécurité de l'IA

FLI célèbre un moment historique pour le mouvement en faveur de la sécurité de l'IA et met en lumière sa dynamique croissante.

3 octobre, 2025

Google DeepMind se retrouve à la traîne derrière OpenAI dans la dernière évaluation de sécurité ; selon les experts, toutes les entreprises spécialisées dans l'IA sont encore loin du compte

La mise à jour estivale 2025 de l'indice de sécurité de l'IA Future of Life Institutemontre que certaines entreprises réalisent des progrès progressifs, mais que des lacunes dangereuses persistent dans des domaines clés tels que l'évaluation des risques et le contrôle des systèmes qu'elles prévoient de mettre en place.

17 Juillet, 2025

Contexte et ordre du jour du sommet pour l'action sur l'IA 2025

Le sommet pour l'action sur l'IA se tiendra à Paris du 10 au 11 février 2025. Voici l'ordre du jour et les principaux résultats attendus.

31 janvier, 2025

FLI Déclaration sur le mémorandum de la Maison Blanche sur la sécurité nationale

La semaine dernière, la Maison Blanche a publié un mémorandum sur la sécurité nationale concernant la gouvernance de l'IA et la gestion des risques. Ce mémorandum fournit des orientations [...]

28 octobre, 2024

Petit-déjeuner sur la sécurité de l'IA à Paris #2 : Dr. Charlotte Stix

Le deuxième de notre série de petits-déjeuners sur la sécurité de l'IA, avec Charlotte Stix sur les évaluations de modèles, les comportements trompeurs de l'IA et les sommets sur la sécurité et l'action en matière d'IA.

14 octobre, 2024

La Chambre des représentants des États-Unis demande la mise en place d'une responsabilité juridique pour les "Deepfakes".

Les récentes déclarations de la Chambre des représentants des États-Unis nous rappellent la menace urgente que représentent les "deepfakes" pour notre société, en particulier à l'approche de l'élection présidentielle américaine.

1 octobre, 2024

Nos contenus

Nous contacter

Nous vous mettrons en contact avec la bonne personne.

Nous nous efforçons de répondre à toutes les questions qui nous sont adressées dans un délai de trois jours ouvrables. Notre équipe est répartie dans le monde entier. Nous comptons donc sur votre compréhension. Tenez également compte du fait que la personne que vous contactez ne se trouve peut-être pas dans votre fuseau horaire.

Veuillez adresser les demandes concernant les médias et les interviews de Max Tegmark à press@futureoflife.org. Toutes les autres demandes peuvent être envoyées à l'adresse contact@futureoflife.org.