Protégez l'humain.

Contactez votre législateur (USA)

Recevez des alertes d'action

Informez les autres

Ce qu'il faut savoir sur l'IA aujourd'hui

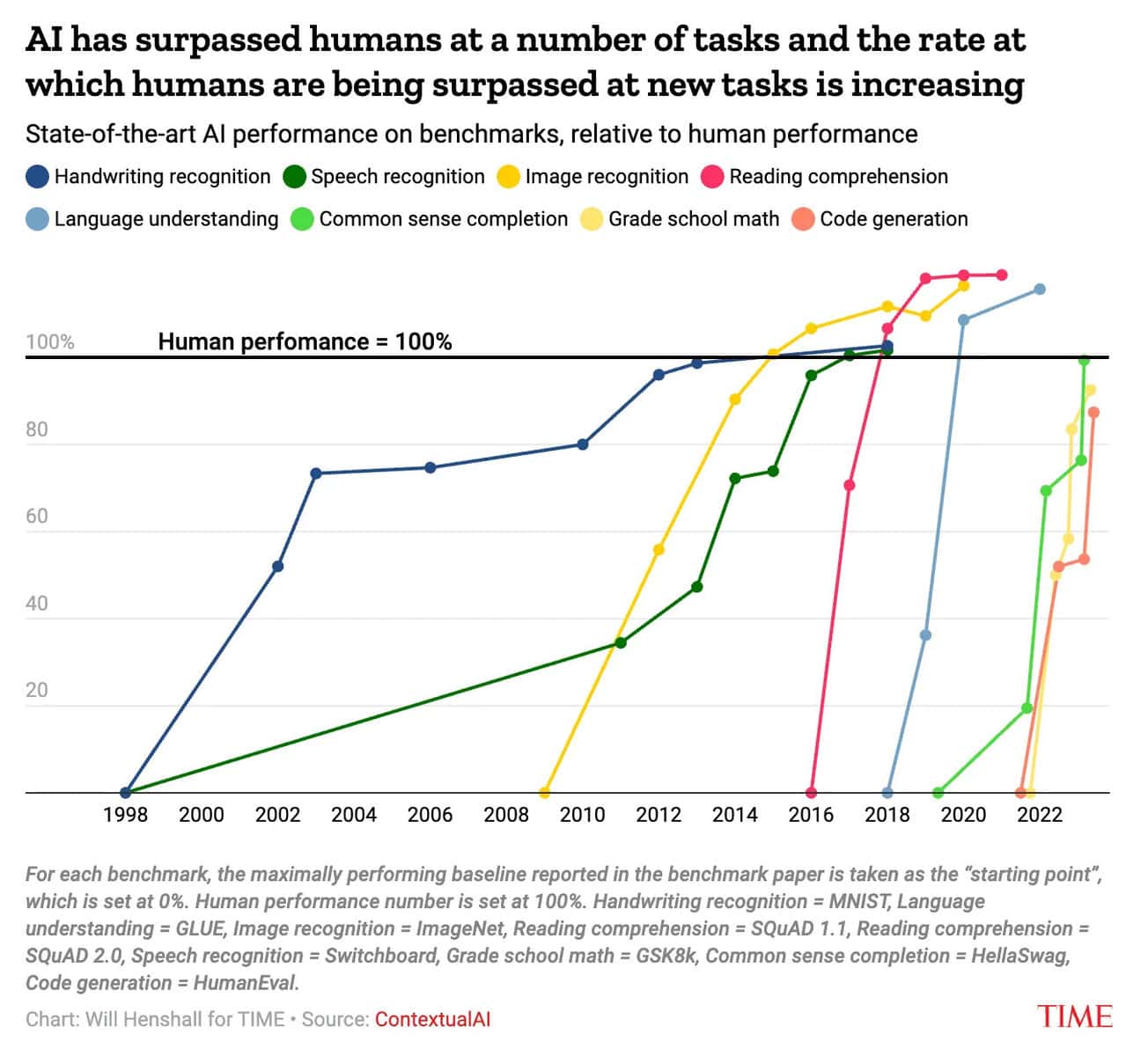

Les capacités de l'IA progressent de manière spectaculaire

Rien que ces dernières années, les modèles d’IA ont appris à imiter les humains, à générer des sons, des images et des vidéos saisissants de réalisme, à battre les meilleurs programmeurs du monde dans des compétitions de code, et à mener des travaux de recherche en toute autonomie. Tous les mois ou presque, de nouvelles capacités — et de nouveaux risques — apparaissent.

Tant que les géants de la tech investissent des budgets toujours plus importants et construisent des data centers toujours plus vastes, on peut s’attendre à une accélération continue des capacités de l’IA.

Les géants de la tech développent des IA explicitement conçues pour remplacer l'humain

Les géants technologiques mondiaux (Google, Amazon, Microsoft, Facebook) ont tous déclaré qu'ils cherchaient à créer une intelligence artificielle générale, ou « IAG » : un type d’IA capable d’exécuter à peu près toutes les tâches qu’un humain peut accomplir.

Leur objectif final n’est PAS de concevoir des produits pour vous, mais pour votre employeur : des IA capables d’accomplir votre travail plus vite, à moindre coût, et sans limite de temps. Ils veulent vous remplacer.

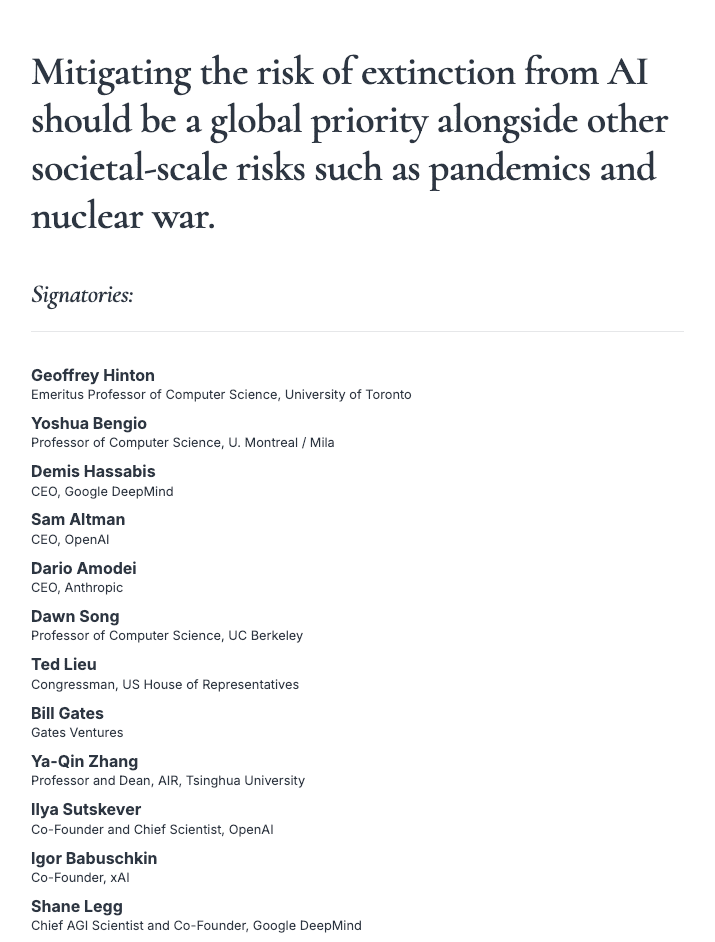

Des experts tirent la sonnette d’alarme

Des milliers d’experts ont alerté sur les immenses dangers posés par les systèmes d’IA puissants : armes biologiques, attaques contre les infrastructures, chômage de masse, voire même extinction.

Mais vous n’êtes pas obligé de les croire sur parole : plusieurs PDG de ces grandes entreprises de tech ont eux-mêmes reconnu publiquement que ces risques étaient bien réels.

Malgré ces alertes précoces, les décideurs continuent de céder aux pressions des lobbys de la tech et refusent d’adopter des mesures de précaution raisonnables.

Rejoignez le #CôtéHumain.

Depuis 2015, des personnes comme vous nous soutiennent dans notre combat pour un avenir humain, un avenir où l'humanité entière est habilitée par les outils d'IA à réaliser son potentiel, et non remplacée par l'IA.

Quelques exemples de la manière dont nous avons travaillé avec des personnes du monde entier pour s'assurer que l'avenir reste humain :

- Plus de 33 000 personnes ont signé la lettre ouverte "Pause Giant AI Experiments" (Mettons en pause les expériences d'IA à grande échelle), appelant à une pause dans le développement de systèmes d'IA plus puissants, y compris des chefs d'entreprise, des leaders communautaires, des familles et des citoyens inquiets. La lettre a lancé une discussion mondiale sur la sécurité et l'éthique de l'IA.

- Plus de 1 000 personnes ont participé à des ateliers, des cours et des hackathons pour élaborer des visions positives de l'avenir avec l'IA. Ces visions façonnent le discours sur les technologies que nous devrions développer et celles que nous ne devrions pas développer.

- Les communautés religieuses du monde entier prennent conscience des avantages potentiels, mais aussi des risques majeurs, posés par l'IA puissante. Elles font entendre leur voix et exercent un leadership moral sur le développement des technologies émergentes.

- Des milliers de personnes ont partagé leurs histoires sur les réseaux sociaux et signé des lettres ouvertes (y compris des leaders jeunesse, des parents, des universitaires, des experts en IA et même d'anciens employés de laboratoires d'IA) pour exprimer leur soutien à un projet de loi californien de 2024 visant à protéger les citoyens des risques liés à l'IA, lorsque son adoption était en jeu.

- Plus de 100 millions de personnes ont visionné et partagé "Slaughterbots", notre série de vidéos virales sur les armes autonomes, à laquelle les décideurs politiques font toujours référence aujourd'hui.

Votre voix compte, soyez prêt à l'utiliser. Nos alertes d'action vous permettent d'agir de manière concrète au moment où c'est le plus important.

Nous devons garder le contrôle sur l'avenir de notre monde ; nous devons stopper le développement d'une IA surhumaine.

Recevez des alertes d'action

Abonnez-vous à la newsletter du FLI

Lancez la conversation essentielle.

Visuels pour les réseaux sociaux

Notre plan pour que les humains gardent le contrôle.

Montrez-leur ce dont l'IA est capable aujourd'hui.

Des deepfakes convaincants sont générés à partir de quelques secondes d'enregistrement à peine

DÉMO : Manipulation de la participation électorale à l'aide de l'IA

Un film entier généré par IA. Quel est son niveau de réalisme ?

Les robots tueurs chinois montrent que la troisième guerre mondiale pourrait tous nous anéantir.

Nos lectures recommandées

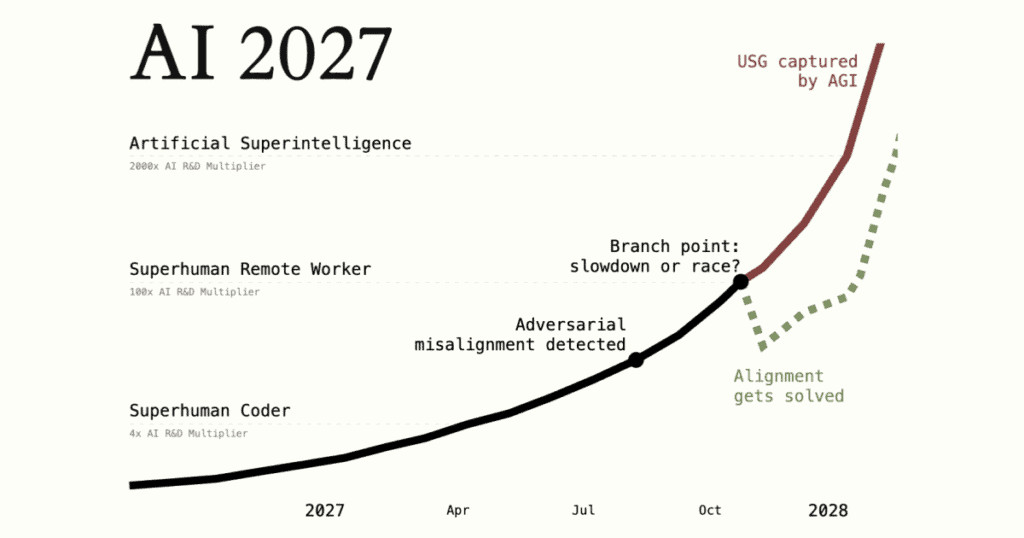

IA 2027

Un chemin étroit

Le compendium

Faites pression sur les entreprises pour qu'elles excellent en matière de sécurité.

Ajoutez votre voix à celle des nombreux citoyens engagés.

Lettre ouverte appelant les dirigeants mondiaux à adopter un leadership à long terme face aux menaces existentielles

Mettre en pause les expériences d'IA de grande envergure : lettre ouverte

Principes d'Asilomar sur l'IA

Participez à nos programmes et initiatives

Nos projets

Accélérateur de médias numériques

Faites un don à la cause.

Nous avons à peine entamé notre liste d'idées de projets. Les dons nous permettent de croître en tant qu'organisation et de concrétiser davantage de nos initiatives.

Visitez la page Notre travail pour en savoir plus sur le ce que nous avons accompli jusqu'à présent et les types de projets que vos dons pourraient aider à soutenir. Découvrez tout ce que vous devez savoir sur les dons sur notre page dédiée :

Retour en haut de la page

Avons-nous oublié quelque chose dont vous auriez besoin ?

Cette page a récemment été repensée pour offrir davantage d’opportunités d’action pertinentes.

N'hésitez pas à nous faire part de vos retours ou commentaires. Nous sommes particulièrement impatients de savoir :

- Si vous cherchiez quelque chose, mais que vous ne l'avez pas trouvé.

- Si vous avez des idées de ressources qui vous semblent utiles.

- Si vous avez particulièrement apprécié certains éléments sur cette page, ou si d'autres vous ont déplu.