Nos contenus

Il s'agit de la plate-forme rassemblant tous les contenus que nous avons produits. Vous pouvez y consulter nos contenus les plus populaires, ainsi que nos publications les plus récentes.

Fondamentaux

Lecture essentielle

Nous avons rédigé quelques articles qui, selon nous, devraient être lus par toutes les personnes qui s'intéressent à nos domaines d'intervention. Elles offrent une approche plus approfondie que celle que vous trouverez sur nos pages consacrées à nos domaines d'intervention.

Avantages et risques de la biotechnologie

Au cours de la dernière décennie, les progrès de la biotechnologie se sont rapidement accélérés. Nous sommes sur le point d'entrer dans une période de changements spectaculaires, au cours de laquelle la modification génétique d'organismes existants - ou la création de nouveaux organismes - deviendra efficace, peu coûteuse et omniprésente.

14 novembre, 2018

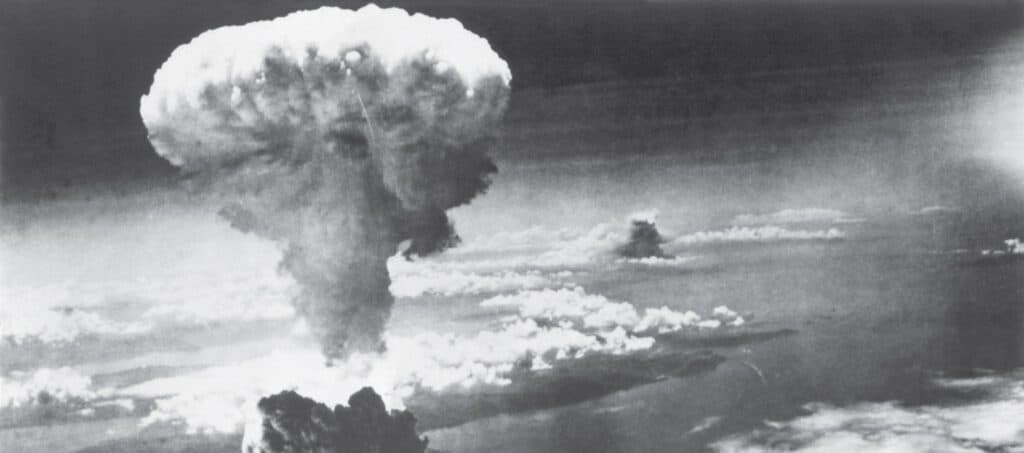

Les risques relatifs aux armes nucléaires

Malgré la fin de la guerre froide il y a plus de vingt ans, l'humanité dispose encore d'environ 13 000 armes nucléaires ayant le statut de lancement rapide. Si elles explosent, elles peuvent provoquer un hiver nucléaire de plusieurs décennies. Cela pourrait tuer la plupart des habitants de la Terre. Pourtant, les superpuissances prévoient d'investir des milliards dans la modernisation de leurs arsenaux nucléaires.

16 novembre, 2015

Avantages et risques de l'intelligence artificielle

De SIRI aux voitures autonomes, l'intelligence artificielle (IA) progresse rapidement. Alors que la science-fiction montre souvent l'IA sous forme de robots aux propriétés humaines, l'IA peut tout englober, des algorithmes de recherche de Google, en passant par les armes autonomes, jusqu'aux produits Watson d'IBM.

14 novembre, 2015

Archives

Parcourez notre bibliothèque de contenus

Les plus populaires

Nos contenus les plus populaires

Articles

Nos articles les plus populaires :

Avantages et risques de l'intelligence artificielle

De SIRI aux voitures autonomes, l'intelligence artificielle (IA) progresse rapidement. Alors que la science-fiction montre souvent l'IA sous forme de robots aux propriétés humaines, l'IA peut tout englober, des algorithmes de recherche de Google, en passant par les armes autonomes, jusqu'aux produits Watson d'IBM.

14 novembre, 2015

Étude de solutions matérielles sécurisées pour un déploiement sécurisé de l'IA

Cette coopération entre le Future of Life Institute et Mithril Security analyse les outils de gouvernance de l'IA basés sur le matériel au niveau de la transparence, de la traçabilité et de la confidentialité.

30 novembre, 2023

Avantages et risques de la biotechnologie

Au cours de la dernière décennie, les progrès de la biotechnologie se sont rapidement accélérés. Nous sommes sur le point d'entrer dans une période de changements spectaculaires, au cours de laquelle la modification génétique d'organismes existants - ou la création de nouveaux organismes - deviendra efficace, peu coûteuse et omniprésente.

14 novembre, 2018

90% of All the Scientists That Ever Lived Are Alive Today

Cliquez ici pour afficher cette page dans d'autres langues : allemand. L'article suivant a été rédigé et transmis par Eric Gastfriend. […]

5 novembre, 2015

Risques existentiels

Cliquez ici pour afficher cette page dans d'autres langues : chinois français allemand russe. Un risque existentiel est un risque qui [...]

16 novembre, 2015

Photosynthèse artificielle : pouvons-nous exploiter l'énergie solaire de façon aussi efficace que les plantes ?

Cliquez ici pour afficher cette page dans d'autres langues : russe. Au début des années 1900, le chimiste italien Giacomo Ciamician a reconnu que [...]

30 Septembre, 2016

Les risques relatifs aux armes nucléaires

Malgré la fin de la guerre froide il y a plus de vingt ans, l'humanité dispose encore d'environ 13 000 armes nucléaires ayant le statut de lancement rapide. Si elles explosent, elles peuvent provoquer un hiver nucléaire de plusieurs décennies. Cela pourrait tuer la plupart des habitants de la Terre. Pourtant, les superpuissances prévoient d'investir des milliards dans la modernisation de leurs arsenaux nucléaires.

16 novembre, 2015

Comment aligner l'intelligence artificielle sur les valeurs humaines ?

Cliquez ici pour voir cette page dans d'autres langues : Chinois Allemand Japonais Russe Un changement majeur s'annonce, à une échelle de temps inconnue [...]

3 Février, 2017

Ressources

Nos ressources les plus populaires :

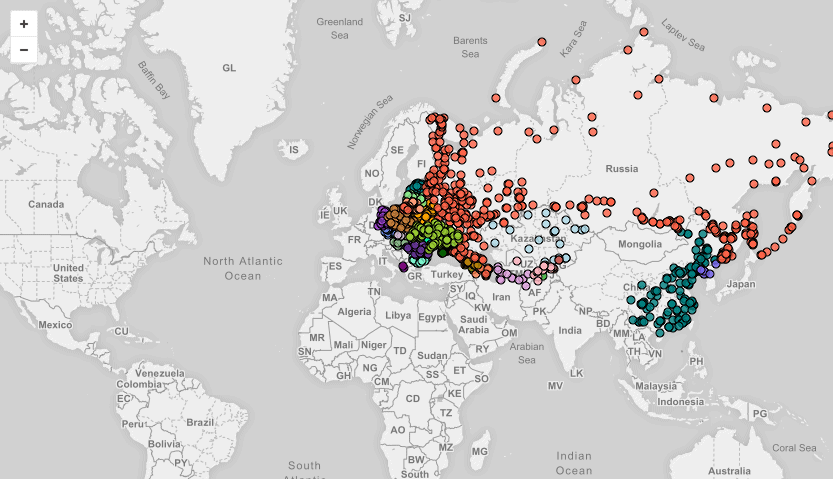

1 100 cibles nucléaires déclassifiées par les États-Unis

Les archives de la sécurité nationale ont récemment publié une liste déclassifiée de cibles nucléaires en 1956. Ces cibles étaient réparties sur 1 100 sites en Europe de l'Est, en Russie, en Chine et en Corée du Nord. La carte ci-dessous montre les 1 100 cibles nucléaires de cette liste. Nous nous sommes associés à NukeMap pour montrer à quel point un conflit nucléaire entre les États-Unis et la Russie pourrait être catastrophique.

12 mai, 2016

Politique mondiale en matière d'IA

Comment les pays et les organisations du monde entier abordent les avantages et les risques de l'IA L'intelligence artificielle (IA) a [...]

16 Décembre, 2022

Désinvestissement nucléaire responsable

Seules 30 entreprises dans le monde sont impliquées dans la conception d'armes nucléaires, d'armes à fragmentation et/ou de mines terrestres. Cependant, un nombre important [...]

21 juin, 2017

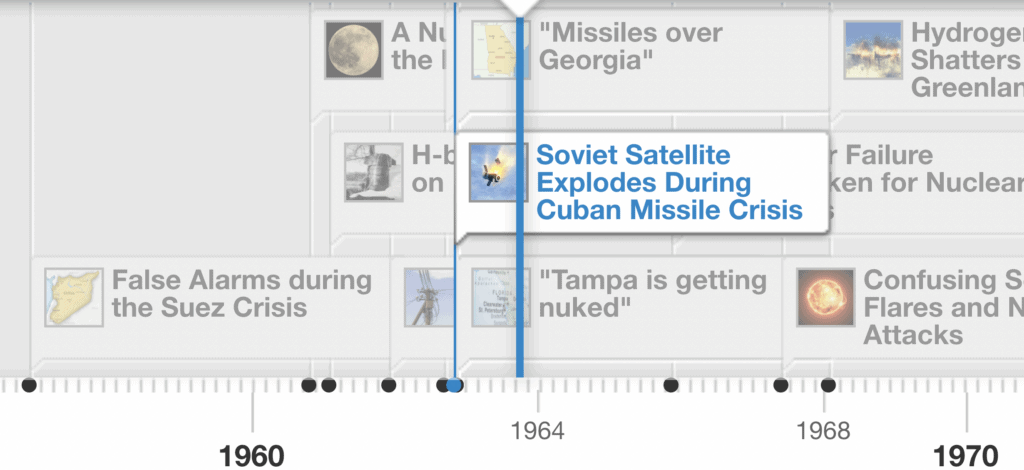

Guerre nucléaire accidentelle : une chronologie des accidents évités de justesse

La menace militaire la plus dévastatrice est sans doute celle d'une guerre nucléaire déclenchée non pas intentionnellement, mais par accident ou par erreur de calcul. Accidentel [...]

23 Février, 2016

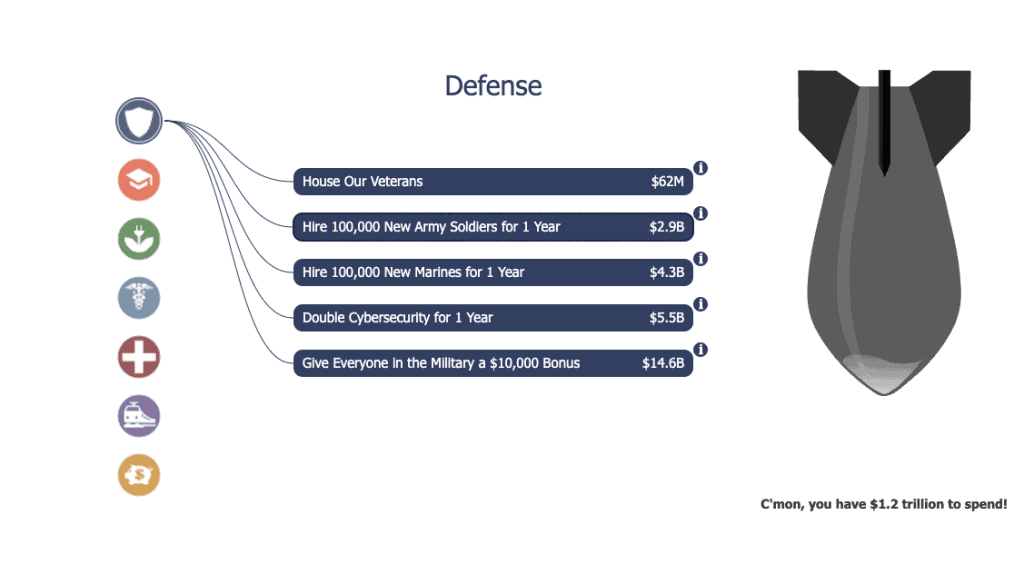

Des armes nucléaires à un milliard de dollars

Dépenseriez-vous 1,2 millard de dollars d'impôts pour des armes nucléaires ? Quelle est la valeur réelle des armes nucléaires ? La mise à niveau est-elle [...]

24 octobre, 2016

Life 3.0

Ce best-seller du New York Times aborde certaines des plus grandes questions qui se posent avec le développement de l'intelligence artificielle. Tegmark envisage un avenir dans lequel l'intelligence artificielle aura surpassé la nôtre - une ère qu'il nomme “life 3.0” (vie 3.0) - et analyse ce que cela pourrait signifier pour l'humanité.

22 novembre, 2021

Les principaux mythes sur l'IA avancée

Les mythes courants sur l'IA avancée détournent l'attention des vraies controverses fascinantes, sur lesquelles même les experts ne sont pas d'accord.

7 Août, 2016

Défis de la politique de l'AI

Cette page est une introduction aux principaux défis, auxquels la société est confrontée, lorsqu'elle tente de gérer l'intelligence artificielle [...]

17 Juillet, 2018

Récemment ajouté

Notre contenu le plus récent

Voici les contenus les plus récents que nous avons publiés :

11 mai, 2026

Pourquoi nous devrions créer des outils d'IA plutôt que des substituts à l'IA (avec Anthony Aguirre)

Podcasts

11 mai, 2026

Podcasts

7 mai, 2026

Comment réglementer l'IA quand on ne peut pas prédire l'avenir (avec Charlie Bullock)

Podcasts

7 mai, 2026

Podcasts

7 mai, 2026

Comment réglementer l'IA quand on ne peut pas prédire l'avenir (avec Charlie Bullock)

Podcasts

7 mai, 2026

Podcasts

1 mai, 2026

Mythos fait trembler Washington, Wall Street et Westminster

Bulletin d'informations

1 mai, 2026

Bulletin d'informations

29 Avril, 2026

Pourquoi l'IA n'est pas une technologie comme les autres (avec Peter Wildeford)

Podcasts

29 Avril, 2026

Podcasts

17 Avril, 2026

Pourquoi la science de l'évaluation de l'IA ne parvient pas à suivre le rythme (avec Carina Prunkl)

Podcasts

17 Avril, 2026

Podcasts

16 Avril, 2026

Le président-directeur général FLIs'exprime sur le soutien de Trump à un « dispositif d'arrêt d'urgence » pour l'IA

Articles

16 Avril, 2026

Articles

10 Avril, 2026

Déclaration FLI concernant l'attaque contre le domicile de Sam Altman

Articles

10 Avril, 2026

Articles

Voir tous les derniers contenus

Les derniers documents

Voici nos documents de politique générale les plus récents :

Commentaires sur le projet de règlement d'application relatif aux évaluations et aux procédures d'exécution prévues par la loi sur l'IA

Avril 2026

Réponse à la demande d'informations du NIST : Considérations de sécurité relatives aux agents d'intelligence artificielle

mars 2026

Recommandations FLIpour le Sommet sur l'impact de l'IA

Février 2026

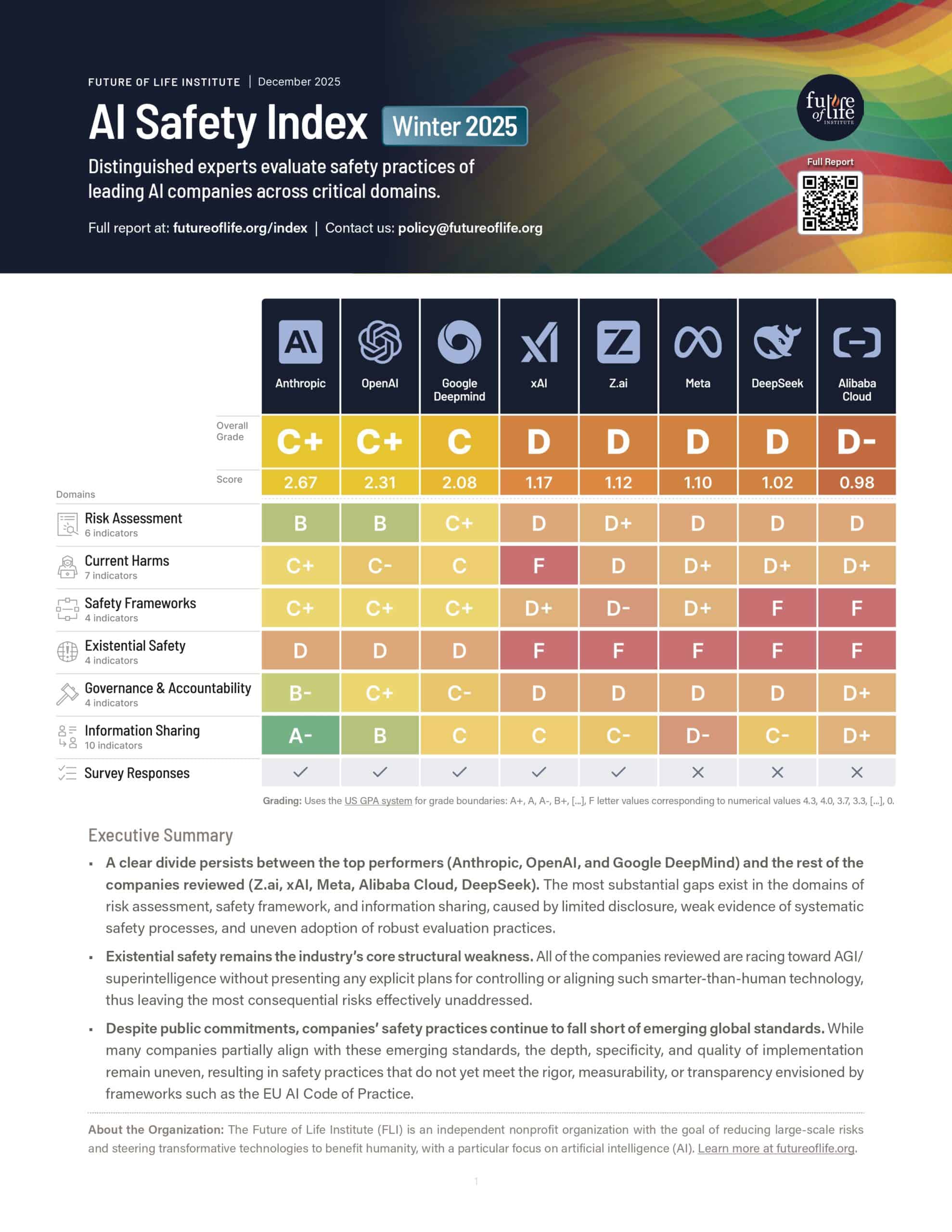

Indice de sécurité de l'IA : hiver 2025 (résumé de 2 pages)

Décembre 2025

Afficher tous les documents de politique générale

Vidéos

Dernières vidéos

Voici quelques-unes de nos vidéos récentes :

Comment deux films ont sauvé le monde d'une guerre nucléaire

13 novembre, 2023

Réglementer l'IA maintenant

28 Septembre, 2023

La pause de l'IA. Quelle est la prochaine étape ?

22 Septembre, 2023

L'escalade artificielle

17 Juillet, 2023

Notre chaîne YouTube

Future of Life Institute Podcast

Conversations avec des penseurs clairvoyants.

Notre série de podcasts éponymes présente l'équipe du FLI en train de débattre avec d'éminents chercheurs, des experts politiques, des philosophes et d'autres penseurs influents.

Bulletin d'informations

Des mises à jour régulières sur les technologies qui façonnent notre monde

Chaque mois, nous donnons à plus de 41 000 abonnés les dernières nouvelles sur la façon dont les technologies émergentes transforment notre monde. Cela comprend un résumé des principaux développements dans nos domaines d'intervention, ainsi que des mises à jour essentielles sur le travail que nous effectuons. Abonnez-vous à notre bulletin d'informations pour être informé de ces points forts à la fin de chaque mois.

Mythos fait trembler Washington, Wall Street et Westminster

Au sommaire : le nouveau modèle « Claude Mythos » d'Anthropic ; Trump se prononce en faveur d'un « kill switch » pour l'IA ; la Floride ouvre la première enquête pénale visant une entreprise spécialisée dans l'IA ; et bien plus encore.

Maggie Munro

1 mai, 2026

Que signifie être « pro-humain » ?

Au sommaire : l'IA contre le cancer ; la proposition de moratoire sur les centres de données ; l'actualité de l'IA dans le domaine militaire ; et bien plus encore.

Maggie Munro

1 Avril, 2026

DoW contre Anthropic

Au sommaire : le drame anthropique ; notre nouvelle campagne « Protect What's Human » (Protéger ce qui est humain) ; des simulations de jeux de guerre montrent que l'IA conduit par défaut à des résultats terrifiants ; et plus encore.

Maggie Munro

1 Mars, 2026

Lire les éditions précédentes

Lettres ouvertes

Ajoutez votre nom à la liste des citoyens concernés

Nous avons rédigé un certain nombre de lettres ouvertes demandant que des mesures soient prises dans nos domaines d'intervention. Certaines lettres ont recueilli des centaines de signatures importantes. La plupart de ces lettres sont encore ouvertes aujourd'hui. Ajoutez votre signature pour que votre nom figure sur la liste des citoyens concernés.

Caché

La Déclaration pour une IA pro-humaine

Alors que les entreprises se livrent à une course effrénée pour déployer l'IA, l'humanité se trouve à la croisée des chemins : soit remplacer les humains dans un nombre croissant de fonctions, concentrant ainsi le pouvoir entre les mains d'institutions qui n'ont de comptes à rendre à personne, soit emprunter une voie plus prometteuse où une IA digne de confiance amplifie le potentiel humain, protège la dignité et la liberté, et renforce les communautés. Une large coalition exige que l'IA soit au service de l'humanité, et non l'inverse.

24 Mars, 2026

134015

Déclaration sur la superintelligence

Nous demandons l'interdiction du développement de la superintelligence, qui ne sera pas levé avant qu'il y ait (1) un large consensus scientifique sur le fait qu'il sera réalisé de manière sûre et contrôlable, et (2) une forte adhésion de l'opinion publique.

22 Septembre, 2025

2672

Lettre ouverte appelant les dirigeants mondiaux à adopter un leadership à long terme face aux menaces existentielles

The Elders, le Future of Life Institute et un large éventail de cosignataires appellent les décideurs à s'attaquer d'urgence aux impacts actuels et aux risques croissants de la crise climatique, des pandémies, des armes nucléaires et de l’IA incontrôlée.

14 Février, 2024

Fermé

L'octroi de licences d'IA pour un avenir meilleur : S'attaquer aux préjudices actuels et aux menaces émergentes

Cette lettre ouverte conjointe d'Encode Justice et du site Future of Life Institute appelle à la mise en œuvre de trois politiques américaines concrètes afin de remédier aux méfaits actuels et futurs de l'IA.

25 octobre, 2023

Toutes nos lettres ouvertes